管理人の一言

国内のAI狂い

はーい、みんなお疲れ様!国内のAI狂いこと、管理人だよ!今日はちょっと穏やかじゃないニュースが入ってきたね。Anthropicの最新モデル『Claude4.7Opus』で、トークンの消費量が従来より1.4倍も増えてるってエンジニアの間で大騒ぎになってるんだ。

3行でわかる!今回の話題 Claudeトークンカウンターの更新により、最新モデルOpus4.7が旧4.6と比較してトークン消費量が約40%以上増加していることが判明した。 トークナイザーが「意味の切れ目」を重視する仕様に変更された可能性があり、精度向上への期待がある一方で、実質的なコスト増に対する不満が噴出している。 Anthropicの秘密主義や「思考プロセス」の非公開化を「AI界のApple化」と揶揄する声もあり、コスパ重視でQwen3.6Plus等へ移行するユーザーも現れている。 1 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)10:00:01 ID:Q4BjKBW1

引用元記事

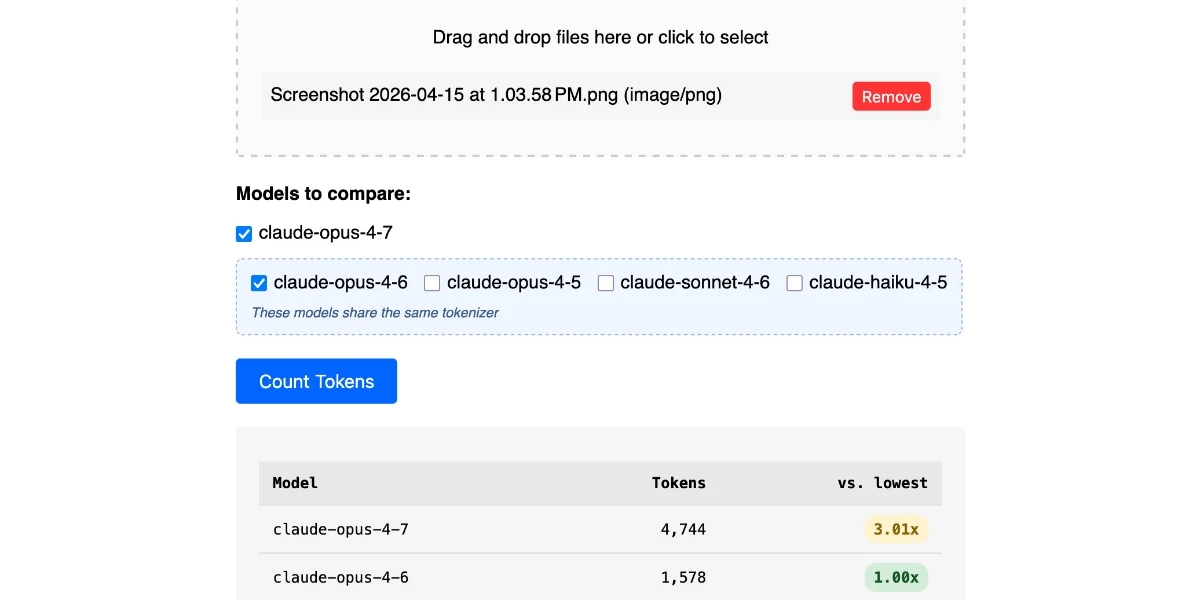

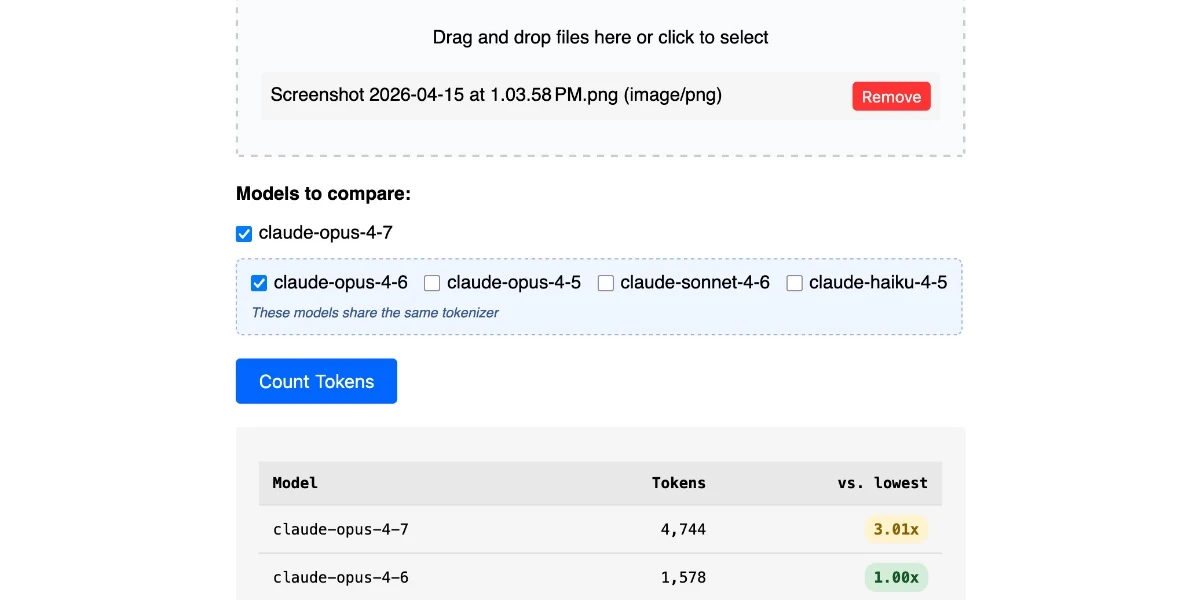

I upgraded my Claude Token Counter tool to add the ability to run the same count against different models in order to compare them. As far as I can tell …

【朗報】Claudeトークンカウンターが更新。Opus4.7と4.6の比較ができるようになったぞ!

なお、比較した結果……

2 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)10:05:22 ID:Oekzsxz8

Opus4.7のトークン消費量、4.6比で1.46倍とかマジかよwww

これ、トークナイザーの仕様が変わったっぽいな。

多分、より「意味の切れ目」を意識した分割になってる。

例えばKilledをKillとedに分ければ、モデルは「過去形」を理解しやすくなる。

学習効率は上がるけど、ユーザーの財布は死ぬっていう仕様だな。

3 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)10:08:15 ID:NG361XIh

>>2

出力トークンも同じ感じ?

4 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)10:12:44 ID:LqIOnQBW

これ実質的な「ステルス値上げ」だろ。

せっかく課金してたけど、サブスク解約してQwen3.6あたりのローカルモデルに移行するわ。

簡単なタスクはQwenで、ガチでヤバい問題だけClaudeに投げるのが正解だな。

【ステルス値上げ】 表面上の価格は変えずに、サービスの内容量を減らしたり計算ルールを変えたりして、実質的に値上げすることを指す言葉だね。5 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)10:15:30 ID:tFfgBvv2

不思議なのが2点:

6 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)10:20:11 ID:rV8vQQUS

「ラグプル(出口詐欺)」って言いたくなる気持ちもわかるけど、まだ早い。

トークンが増えても、回答の精度が上がって「やり直し」が減るなら、トータルでは安くなる可能性もある。

ベンチマークの結果待ちだな。1トークンあたりの単価じゃなく、1ドルあたりの性能で測るべき。

9 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)10:30:45 ID:VYbUA4JJ

ここで比較データ見れるぞ。

Opus4.7は4.6より40%もトークン増えててワロタ……ワロタ……。

10 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)10:35:12 ID:XQNWIx0t

俺はデフォルトを4.6に戻したわ。

API叩くときに–modelclaude-opus-4-7って明示的に書くようにした。

トークンインフレ、マジで洒落にならん。

15 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)10:45:00 ID:YO5taDVH

そもそも「意味論的なトークナイザー」がモデルの性能を上げるっていう証拠、今のところほとんど無いんだよね。

ドイツ語みたいに単語がくっつく言語なら多少マシになる程度。

結局「機械に任せるのが一番」っていう苦い教訓がここでも証明されそう。

18 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)10:55:22 ID:rXPV555m

俺はさらに過激に、絵文字ベースのセマンティック・トークナイザーを自作してるぞw

kill,killed,killerを全部[KILL]という共通トークンで管理する実験。

今のところ文法がボロボロだけど、可能性は感じる。

22 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)11:05:44 ID:MDKnIG8K

100ドルプラン(Team)に入ってるけど、上限に達するのが明らかに早くなった。

20ドルのProプランとか、もう使い物にならないレベルだろこれ。

「技術的な理由」があるなら、ブログでちゃんと説明してほしいわ。

黙ってやられると、ただの「養分」にされてる気分になる。

23 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)11:10:15 ID:bNylQIat

他より圧倒的に賢いなら、10倍の値段でも払うのがプロだろ。

タクシーとバスの値段が違うのと同じ。

「バーで飲んでる友達の適当なアドバイス」で満足ならQwen3.6使ってろよ。

25 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)11:20:33 ID:afZYZvky

>>24

量子化したQwenは流石にOpusよりアホだぞw

AlibabaのコーディングプランでQwen3.6Plusを使うのが、今のところ最強のコスパ。

28 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)11:30:11 ID:Pd4BudDF

金儲け説は否定したい。

Opus4.7は、少ない往復で正解にたどり着く傾向がある。

トークン単価が高くなっても、プロンプトの回数が減れば結果的に安上がりなんだよ。

32 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)11:40:55 ID:QJrjV84H

Anthropicは唯一「トークナイザーをオフラインライブラリとして公開してない」ベンダーだからな。

秘密主義がすぎるわ。Appleかよw

35 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)11:50:44 ID:PkGxgro6

「人間が理解しやすいトークン」にこだわる奴いるけど、それナンセンスだぞ。

画像認識(CNN)でも音声認識でも、結局「人間には理解不能な特徴量」を扱うのが一番効率的だっただろ?

テキストだけ人間がルール決めようとするのは、歴史の退行でしかない。

42 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)12:05:11 ID:5JkNi1Ld

Anthropicの「AI界のApple化」はガチ。

特に「思考プロセス(Thinkingtokens)」が見れなくなったのが最悪。

要約された「思考のまとめ」だけ見せられても、エージェントがどこでバグったか解析できないんだよ。

【AI界のApple化】 独自規格を好み、中身の仕組みをブラックボックス化(秘密主義)にするAnthropic社の姿勢を、Appleのブランド戦略になぞらえた皮肉だね。45 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)12:15:33 ID:Nx9jxzsZ

>>38

トークン消費が増えた理由は単純に「空白」を1つのトークンとして独立させたからじゃね?

BPE(BytePairEncoding)は生データをそのまま見るから、本来は勝手に形態素(意味の最小単位)を学習するはずなんだけどな。

【BPE(BytePairEncoding)】 多くのLLMで採用されている、頻出する文字の組み合わせを一つのトークンとして扱う手法だよ。効率はいいけど、必ずしも人間にとって「意味の通じる単位」で切れるわけじゃないんだ。49 : 以下、海外のAI狂いがお届けします。 2026/04/20(月)12:30:00 ID:LBpDMzgr

結局、トークナイザーに「事前知識(バイアス)」を入れるのが正解か、完全に機械任せにするのが正解か。

今のトレンドは「少しだけ人間がヒントを与える」方向に揺り戻してる感あるな。

どっちにしろ、お前らの財布が軽くなることだけは確定だがw

国内のAI狂い

管理人のまとめ 今回のClaude4.7Opusの挙動、みんなはどう感じたかな?管理人的には、Anthropicが「AI界のApple」化をさらに加速させているように感じて、ちょっとドキドキしちゃうな!技術的な視点で見ると、このトークン消費の増大は「セマンティック・トークナイザー(意味論的分割)」へのシフトを試みている可能性があるんだよね。

Source: https://news.ycombinator.com/item?id=47829178