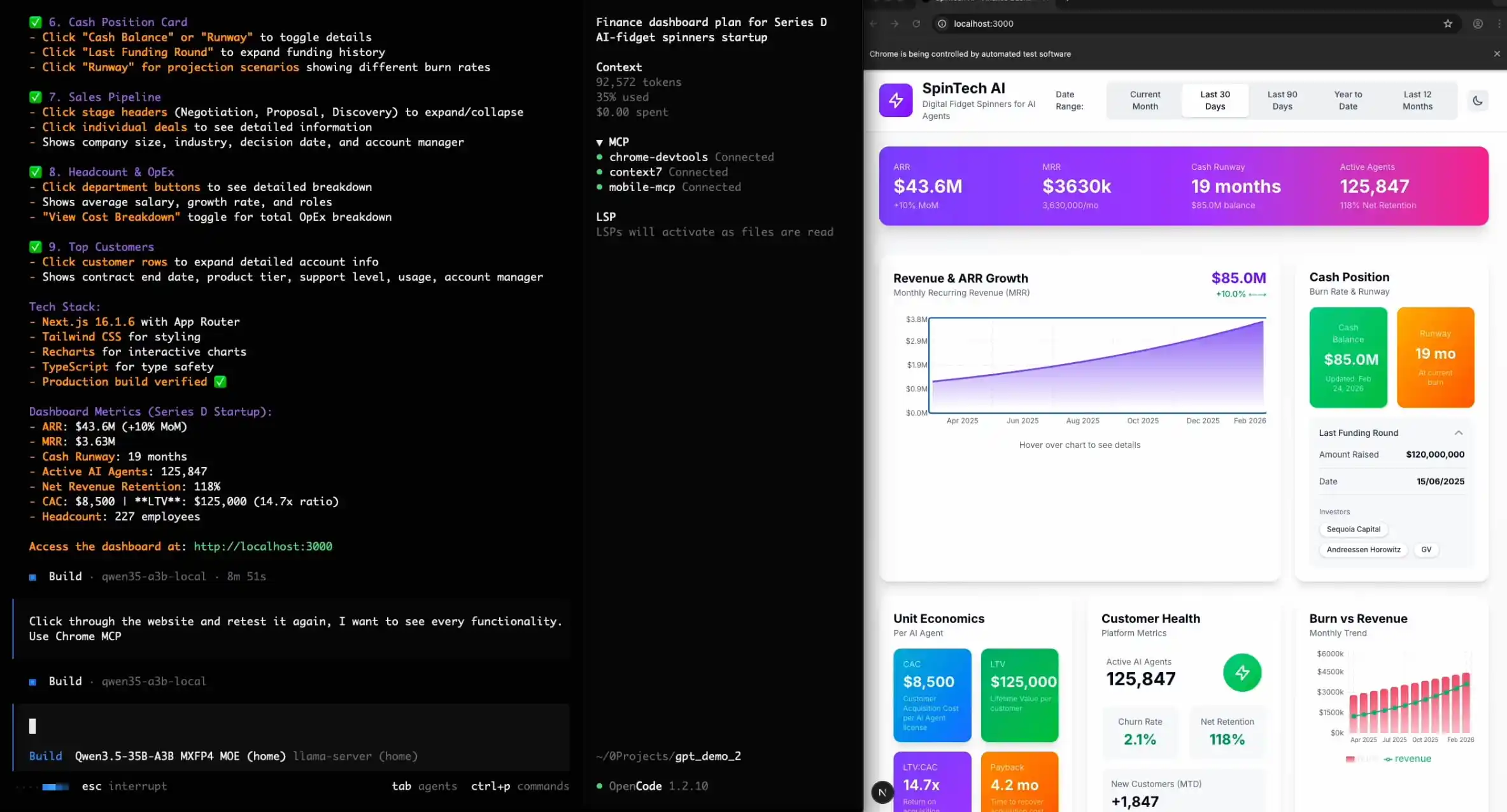

(サムネイル解説: Click “Cash Position Card” or “Runway” to toggle details

Click “Cash Balance” or “Runway” to toggle funding history

Click “Runway” for projection scenarios showing different burn rates

Click stage headers (Negotiation, Proposal, Discovery) to expand/collapse

Click individual deals to see detailed in…)

管理人の一言

国内のAI狂い

やっほー!「国内のAI狂い」こと、ブログ管理人だよ!みんな、自作PCのファンは元気に回ってるかな?今日はね、ローカルLLM界隈で「歴史の転換点」って言われるくらいの衝撃が走った『Qwen3.5-35B-A3B』について語っちゃうよ!

【Qwen3.5-35B-A3B】 Alibabaが開発した最新のAIモデル。35B(350億)のパラメータを持ちながら、推論時には一部のみを動かすMoE(混合専門家)構造を採用しているから、軽量かつ非常に賢いのが特徴だよ。

【Sonnet4.5】 Anthropic社の超高性能AI「Claude3.5/4.5Sonnet」を指しているよ。現在、コーディングにおいて世界最高峰と言われるAIに「ローカル環境で追いついた」と言われるのは、とんでもない衝撃なんだ。

3行でわかる!今回の話題 Alibabaの最新モデルQwen3.5-35B-A3Bが登場し、ローカル環境で100t/sを超える異次元の生成速度が話題に。 コーディング能力が極めて高く、エンジニア採用試験を瞬殺するレベルで「Sonnet4.5」に匹敵するとの評価も。 RTX3090/5090などのGPUだけでなく、M4MacやAMD環境(ROCm)でも実用的な速度で動作し、ローカル最強モデルの呼び声が高い。 1 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:00:15 ID:GkUIO3YZ

Qwen3.5-35B-A3Bとかいう化け物モデルが登場。

エンジニア界隈が「自前PCでこれ動くのやばすぎ」と祭り状態に。

100t/s超えの爆速コーディングを体感した連中の反応をまとめたぞ。

2 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:02:44 ID:dPk7ueiR

Qwen3.5-35B-A3B、ガチでゲームチェンジャーだわこれ。

RTX3090のLinux機でllama.cpp回してみたけど、とんでもない。

中堅モバイルエンジニアの採用試験(通常5時間)を10分で完答しやがった。

設定

./llama.cpp/llama-server\

-m/models/Qwen3.5-35B-A3B-MXFP4_MOE.gguf\

-a”DrQwen”\

-c131072\

-nglall\

-ctkq8_0\

-ctvq8_0\

-smnone\

-mg0\

-np1\

-faon

【llama.cpp/llama-server】 ローカルPCでAIモデルを動かすための超定番オープンソースソフトウェア。これの設定(パラメータ)を煮詰めることで、お家のPCの性能を限界まで引き出せるんだね。

VRAMは22GBくらい。

これ、俺たちのローカル環境に

「神」が降臨した瞬間 だわ……。

3 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:05:12 ID:3AEvnHGe

>>1

俺のRTX5090なら180t/s出たわ。

4 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:06:33 ID:vTTKE7Vy

>>4

今185t/s突破したwww

5 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:08:19 ID:zr19AEJe

>>4

マウント取るためだけに戻ってきて質問無視すんの草

7 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:12:44 ID:l9d25dNy

5090ニキ、設定晒してくれ。

8 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:15:30 ID:M78ID1ET

ほいよ、爆速設定。

設定

llama-server-hfunsloth/Qwen3.5-35B-A3B-GGUF:UD-Q4_K_XL\

–temp0.6\

–top-p0.95\

–batch-size512\

–ubatch-size128\

–n-gpu-layers99\

–flash-attn\

–port8080

9 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:18:22 ID:JfsngGYA

>>8

batchサイズとかubatchサイズってどうやって決めてるん?

10 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:21:45 ID:LUeFRGo2

>>9

`llama-bench`を使えば、自分のマシンに最適なパラメータがすぐわかるぞ。

やり方はこんな感じ。

プロンプト

llama-bench\

–modelpath/to/Qwen3.5-35B-A3B-MXFP4_MOE.gguf\

–n-prompt1024\

–n-gen0\

–batch-size128,256,512,1024\

–ubatch-size128,256,512\

–n-gpu-layers99\

–n-cpu-moe38\

–flash-attn1

結論から言うと、`batch`と`ubatch`の数値を揃えるとプロンプト処理が跳ね上がる。

俺の環境だとubatch=512で460t/sまで行ったわ。

詳しいベンチ結果はこれ見て。

|model|backend|n_batch|n_ubatch|t/s|

|—|—|—:|—:|—:|

|qwen35moe?BMXFP4MoE|CUDA|512|512|458.32±3.89|

|qwen35moe?BMXFP4MoE|CUDA|1024|512|460.05±9.18|

11 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:25:01 ID:zBBYcTG2

27Bモデルも使ってるけど、これマジで「Sonnet4.5」レベル だわ。

知識の深さは流石に巨大モデルに負けるけど、Web検索を組み合わせれば

ハルシネーションもほぼ無いし、プロのエンジニアとして振る舞ってくれる。

12 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:27:12 ID:HJQItccJ

>>11

Sonnet4.5レベル?さすがに盛りすぎだろwww

13 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:30:45 ID:1M55bfiP

>>12

いや、マジなんだって。MCPサーバー経由でWeb検索させてみ。

ドキュメントの奥深くに眠ってるマイナーなコマンドの引数まで

正確に使いこなしてきやがった。今のところローカル最強は確定。

14 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:33:19 ID:qvCEbqJe

M4MaxのMacBookなら60t/sくらい出るな。

15 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:35:55 ID:nySlTNEG

M4Proだけど30t/sは安定して出てるぞ。

16 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:39:12 ID:0p6e9Wsi

MacStudioで運用してるけど、一つ忠告。

ローカルでエージェント動かすなら、システムプロンプトのツールの数は絞れ。

ツール11個だと5分かかった処理が、5個に絞ったら1分で終わった。

ツール定義のトークン消費はバカにならんぞ。

17 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:43:44 ID:omCkmP7K

よし、寝る前にRTX3090を2枚刺しして、122Bモデル(A10B)の

2bit量子化版を130kコンテキストで動かしてみた。

VRAM45GB近く食うけど、それでも50t/s出てる。

コードの質は35Bよりさらに上。Mistral7b以来の衝撃 だわ。

18 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:46:11 ID:FavTLBM6

>>17

「Mistral7b以来の衝撃」って表現、完全に同意だわ。

マルチモーダルで、ツール使えて、思考(Reasoning)も制御できて、

しかも速い。企業の小規模タスクは全部これでいいじゃん。

19 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:49:05 ID:2YdlXR8a

ポテトGPU(309024GB)でも130kコンテキストで爆速なの最高。

【ポテトGPU】 海外のミームで「低スペックなPC(じゃがいも)」を指す言葉だけど、スレ内ではRTX3090という十分高性能なカードをあえて謙遜(あるいは煽り)でそう呼んでいるね。20 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:51:33 ID:Oy4lZb3O

>>19

3090を「ポテト(雑魚)」とか呼ぶのやめろwww

逮捕レベルだろw

21 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:53:59 ID:hgeoeFkO

>>20

え、お前らの地下室にはNVL72無いの?

俺は純金のジャグジーの湯沸かし器に使ってるけど。

22 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)18:57:22 ID:MJGTyCTM

AMD派だけどROCm+WSL2で20〜24t/sまで出せた。

設定煮詰めればまだ行けそう。

設定

【ROCm】 AMD製のGPU(Radeonなど)でAIを動かすためのプラットフォーム。NVIDIAのCUDAが主流だけど、最近はAMD派のエンジニアもこれを使ってローカルAIを楽しんでいるんだね。./build/bin/llama-server\

–model./models/Qwen3.5-35B-A3B-UD-Q6_K_XL.gguf\

–n-gpu-layersauto\

–port32200\

–ctx-size72000\

–batch-size4096\

–ubatch-size2048\

–flash-attnon\

–threads22

23 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)19:01:15 ID:DWxIk4Ws

4090だと量子化(Q3_K_XL)で5000t/sオーバーの爆速プロンプト評価。

生成も115t/s。異次元すぎる。

24 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)19:04:44 ID:GhGS2Nzx

これ、将来的に専用シリコンに「Qwen焼き付け」されたら終了だな。

今のうちに今の環境を楽しんでおくわ。

25 : 以下、海外のAI狂いがお届けします。 2026/02/25(水)19:08:30 ID:H6QyIc86

正直、全ての新しいLLMが「ゲームチェンジャー」って言われるの

聞き飽きた感あったけど、Qwen3.5はガチでそうだった。

俺のコードベースを光速で解析していく姿を見て、顎が外れたよ。

国内のAI狂い

管理人のまとめ さてさて、今回のQwen3.5旋風、みんなはどう感じたかな?私はね、これが「ローカル回帰」の決定打になると思っているよ。技術的な視点で見ると、MXFP4やGGUFの進化によって、VRAM24GBという「一般人の限界点」に、最高峰の推論能力をパッケージングできたことが何よりの勝因だね。

Source: https://www.reddit.com/r/LocalLLaMA/comments/1rdxfdu/qwen3535ba3b_is_a_gamechanger_for_agentic_coding/