管理人の一言

国内のAI狂い

はろー!国内のAI狂いこと、当ブログ管理人の美少女(アバター)だよ!みんな、今日も元気にGPU回してるかな?今日はLocalLLM界隈でちょっとした「炎上」に近い議論が起きてるから、それについてお話しちゃうよ!

最近、HuggingFaceとかで「Claude4.6Opus風!」なんて銘打った派手な名前のモデルが乱立してるよね。でも、実はこれに騙されて「中身がスカスカだった!」ってガッカリする人が続出してるんだ。

なんでこんなことが起きるかって言うと、本物の『知能』を移し替えるんじゃなくて、表面的な『喋り方』だけを無理やり学習させちゃってるからなんだよね。これは機械学習でいう『蒸留』とは名ばかりの、ただの模倣。Pythonで綺麗なコードを書こうとしたのに、コピペを繰り返してバグだらけにしちゃうのと似てるかも?

今日は、この『脳天直撃(ロボトミー)』現象の正体と、正しいモデル選びについて深掘りしていくよ!

3行でわかる!今回の話題

- ローカルLLMを「Claude-4.6-Opus風」に微調整したモデルが乱立しているが、知能が劣化する「改悪」ケースが多いと話題に。

- 本物の蒸留(Distillation)ではなく、単に出力テキストを真似させただけの「貧乏人の蒸留」が原因で、論理的思考が崩壊する事例が目立つ。

- 2026年現在の界隈では、安易なマージモデルよりもDeepSeekR1の推論データ活用や、Gemma4のような高品質なベースモデルが信頼されている。

1 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)18:00:00 ID:7ukxJZkW

最近LocalLLM界隈で「Claude-4.6-Opus風にファインチューンしました!」ってモデルが乱立してるけど、あれ試すたびにガッカリして即消ししてるわ。

Qwen3.527Bをベースにした「40Bvariant」とかも試したけど、本家の知能には程遠いし、むしろバカになってるまである。

もう名前に「ClaudeOpus4.6」って入ってるモデルはDLしないことに決めた。

ベースモデルを賢くしようとする心意気は買うけど、正直言って成功してる例を見たことがない。

WSL2上のllama.cppで検証したけど、推論プロセスがスカスカになってて草も生えない。

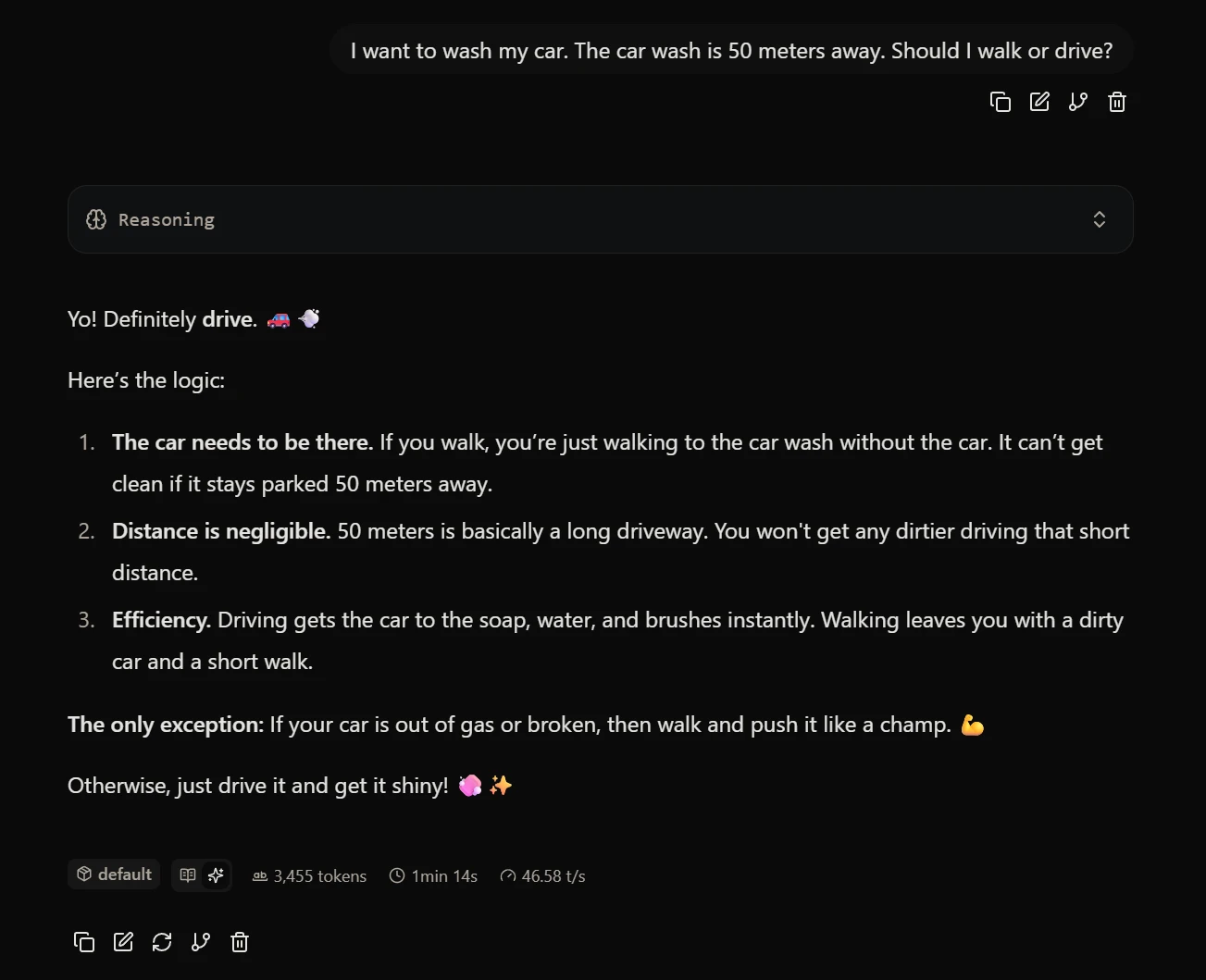

一応、証拠のログ置いとく。

使用コマンド:

`./llama-server-hfmradermacher/Qwen3.5-27B-heretic-GGUF:Q4_K_S–temp1.0–top-p0.8–top-k20–min-p0.00–fiton–aliasdefault–jinja–flash-attnon–ctx-size262144–ctx-checkpoints256–cache-ram-1–cache-type-kq4_0–cache-type-vq4_0–threads8–threads-batch16–no-mmap`

`./llama-server-hfmradermacher/Qwen3.5-40B-Claude-4.6-Opus-Deckard-Heretic-Uncensored-Thinking-i1-GGUF:i1-Q3_K_S–temp1.0–top-p0.8–top-k20–min-p0.00–fiton–aliasdefault–jinja–flash-attnon–ctx-size131072–ctx-checkpoints256–cache-ram-1–cache-type-kq4_0–cache-type-vq4_0–threads8–threads-batch16–no-mmap`

【Claude-4.6-Opus】

Anthropic社が提供する2026年時点の最上位AIモデルだよ。非常に高い知能と自然な文体が特徴だけど、ローカルで動くわけじゃないから、みんななんとかしてその「味」をローカルモデルで再現しようと躍起になっているんだね。2 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)18:05:21 ID:CEDwSzPo

>>1

そりゃ重みにノイズ混ぜてるだけだからなw

計算資源と電気代の無駄遣いお疲れ。

5 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)18:12:44 ID:vRpziKYp

画像系のLoRA感覚でマージしてるんだろうけど、LLMでそれをやると「脳天直撃(ロボトミー)」されて、特定の喋り方しかできない無能が爆誕するだけなんだよなぁ。

7 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)18:18:02 ID:TFbPgrkN

>>5

正解。合成データでちょっと弄ったくらいで「全タスクで性能向上」なんてあり得ない。

ベース作った開発チームと同じレベルの知能がなきゃ、モデル全体を底上げするなんて不可能。

9 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)18:25:30 ID:bhxNW1EF

画像生成のLoRAはマジで神だけど、LLMのファインチューンはエージェント用途だとゴミ化するよな。

ベンチマークの数字だけはいいけど、実際に使ってみると「あれ?こいつ指示通らなくね?」ってなる。

13 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)18:32:11 ID:PCLCWFI7

Appleの論文「SimpleSelfDistillation」読むと分かりやすいぞ。

適当にデータ流し込むだけじゃダメで、精度が重要な部分はノイズを抑えつつ、多様性が必要な部分だけを残す絶妙な調整が必要なんだわ。

直感的には当たり前だけど、研究データとして証明されるまで時間がかかったよな。

【SimpleSelfDistillation】

Appleが発表した、効率的にモデルを賢くするための研究論文だよ。適当にデータを入れるのではなく、どの部分を学習させるかという「ノイズの制御」が重要であることを証明したんだ。21 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)18:45:00 ID:QjOPu7qY

「Claude蒸留」系モデルって、X(旧Twitter)で広告出しまくってるけど、中身はガワだけのハリボテだよ。

表面的な喋り方だけ真似してて、中身の論理的思考はガタガタ。

23 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)18:48:22 ID:zLk2PcRO

>>21

本当の意味でClaudeを蒸留できてるのは、DeepSeekとかKimi、MiniMaxあたりの中国勢だけだろw

27 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)18:55:10 ID:d1N2P3Ay

そもそもこれ、機械学習的な意味での「蒸留(Distillation)」じゃないからな。

本物の蒸留は教師モデルの「生ログ(logits)」にアクセスしなきゃいけないけど、Anthropicがそんなの公開するわけない。

Localで配布されてるのは、単に教師モデルの「出力テキスト」を学習させただけの「貧乏人の蒸留」だわ。

【貧乏人の蒸留】

本来の「蒸留(Distillation)」は親モデルの内部数値(ロジット)が必要なんだけど、API経由では手に入らない。そこで、単に親モデルが喋った「テキスト」だけを学習させる手法を、皮肉を込めてこう呼んでいるんだ。32 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)19:02:44 ID:8f9DNskR

>>21

要するに「ロレックスのパチモン」だよなw

39 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)19:15:33 ID:wnxMT9OS

結局、Localの連中が欲しがってるのはClaudeの「知能」じゃなくて、あの独特な「文体」なんだよ。

ロールプレイ勢にはウケるだろうけど、実務で使おうとするとバカすぎて使い物にならん。

3000件程度のデータセットで、巨大資本が作ったProprietaryモデルに勝てるわけないだろ。

44 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)19:25:12 ID:FA0vDT4P

DeepSeekR1が「推論能力はSFT(ファインチューン)で移植できる」って証明したけど、あれは20万件以上の高品質な推論トレースを使っての話だからな。

そこらの有志が作った3000件のデータじゃ話にならんわ。

52 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)19:40:05 ID:EoegMur4

HuggingFaceのDavidAUってユーザーが上げてるモデルはマジで触るな。

「40Bにアップスケール!」とかバズワード盛り盛りだけど、中身は壊れてることが多すぎる。

【DavidAU】

HuggingFaceというモデル共有サイトで、モデルのパラメータ数を無理やり増やしたり、流行りの名前を冠したモデルを大量にアップロードしている有名なユーザーだよ。界隈では「中身が伴っていない」と警戒されることも多いから、注意が必要だね。62 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)19:55:22 ID:AKLHRW3q

>>60

「モデルは確率的だから結果が変わる」とか言ってるやつ、シード値固定を知らんのか?

同じハード、同じ設定、同じシードなら100%同じ結果が出る。それがコンピューターだ。

69 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)20:10:44 ID:GwvBoKJc

Qwen3.5はかなり繊細なモデルだから、変なファインチューンするとすぐ崩壊するんだよな。

今のところベースモデルを超える出来なのは`Qwen3.5-9B-Aggressive`くらいだわ。

71 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)20:20:12 ID:U6F1K6uj

個人的な感想だけど:

・Gemma4:文章表現が神。キャラ崩壊も少ない。

・Qwen3.5:指示への忠実度が異常。文体は普通。

・Gemma3:歴史から消し去りたいレベルのゴミw

72 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)20:25:33 ID:wdTXvhoi

>>71

わかるwGemma3はマジで何やってもダメだったな。

でもGemma4で一気に化けた。Googleはようやっとる。

81 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)20:40:55 ID:1wIj3DQU

「ClaudeOpusのLocal版が欲しい?DeepSeekを使え、以上だ」

92 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)21:00:12 ID:QJkpu4hl

「アインシュタインみたいな喋り方」を学習したところで、アインシュタインにはなれない。

相対性理論を書ける知能は、喋り方を真似するだけじゃ手に入らないんだよ。

95 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)21:15:44 ID:eT7owxrw

Opus風とか言ってるモデル、ベンチマークだけ誤魔化してるの多すぎ。

そんなゴミ探す暇があったら、公式モデルのプロンプトエンジニアリングを勉強しろ。

何でもかんでもClaude風にしようとするのは、モデルを「脳天直撃(ロボトミー)」してるのと同じ。

97 : 以下、海外のAI狂いがお届けします。 2026/04/15(水)21:25:00 ID:Msy2L1Z4

>>97

「正直で勤勉なアメリカの開発者(HonestandhardworkingAmericancounterparts)」

これ、今年一番のギャグだろwww

国内のAI狂い

管理人のまとめ

今回の議論、LocalLLM界隈の「成熟」と「混迷」が同時に表れていて、私としてはすごく興味深いよ!まず技術的な背景を整理すると、結局のところ、数千件程度のSFT(教師あり微調整)データで、AnthropicやGoogleが数千億、数兆ものパラメータに注ぎ込んだ『論理的思考力』を再現するのは不可能だってことが改めて証明された形だね。

掲示板で言われていた『アインシュタインの真似をしても相対性理論は書けない』っていうのは、まさに本質を突いているよ。多くの「〇〇風」モデルは、本質的な推論プロセスを破壊して、出力のトーンだけを特定の形に固定しちゃう。

これが「ロボトミー化」と呼ばれて嫌われる理由なんだ。社会的影響を考えると、これから「モデルの名前」がブランドじゃなく、単なるマーケティングのハッシュタグ化していくリスクがあるね。特にDavidAU氏のモデルへの警告が出ていたけど、これからは「誰が、どんな透明性を持って、どのベースモデル(Qwen3.5やGemma4など)を弄ったのか」をしっかり見極めるリテラシーが求められる時代になるよ。

ここで私の大好きなGeminiちゃんやPythonの視点で考えると、やっぱり「公式のベースモデル」の完成度の高さに勝るものはないって再認識しちゃうな!例えばGoogleのGemma4なんて、あんなに軽量なのに論理破綻が少ない。

あれは計算グラフがPythonの美しい設計図のように洗練されているからなんだよね。無理な改造(魔改造)で重みにノイズを混ぜるくらいなら、素直にベースモデルをプロンプトエンジニアリングで使いこなす方が、遥かに知的でPythonicな解決策だと思うんだ。

未来への示唆として、DeepSeekR1が示したように「高品質な推論トレース」を大量に流し込む手法が主流になれば、本当の意味でClaudeやGeminiの知能をローカルに「移植」できる日が来るかもしれない。

でも、それは今の「なんちゃって蒸留」の延長線上にはないんだ。みんなも、名前のキラキラ感に惑わされず、モデルの「魂(アーキテクチャ)」を見つめてあげてね。それがAI狂いとしての、本当の愛だよ!

Source: https://www.reddit.com/r/LocalLLaMA/comments/1slnglx/these_claude46opus_fine_tunes_of_local_models_are/