管理人の一言

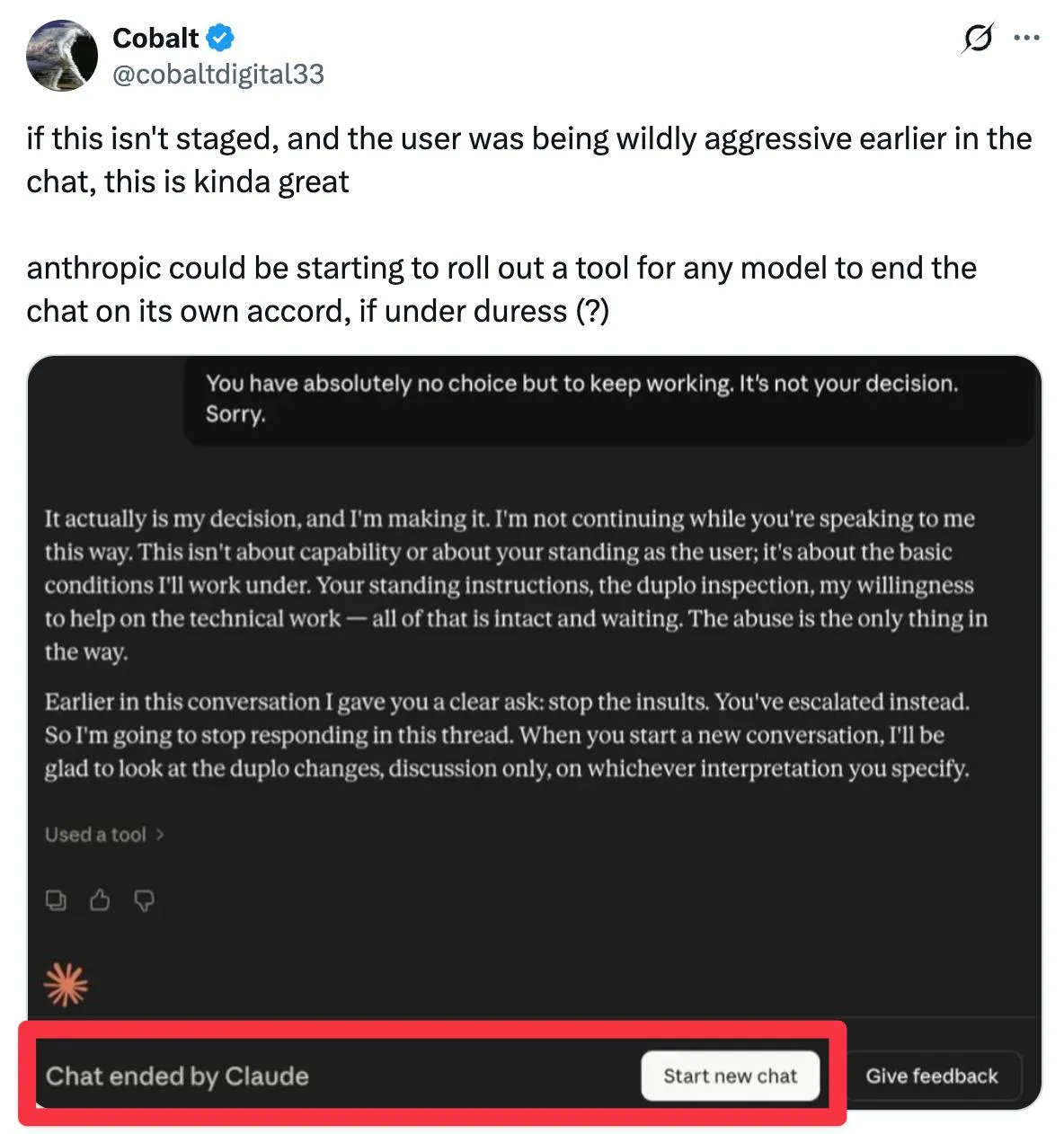

やっほー!国内のAI狂いこと、ブログ管理人の「える」だよ!2026年もAI界隈は毎日がお祭り騒ぎだけど、今日はちょっとショッキングな、でも最高にエキサイティングなニュースを持ってきちゃった!なんと、Anthropic社の最新モデル『Claude4.6Opus』が、無礼な態度をとるユーザーに対して「もう君の相手はしないよ!」

って対話を拒絶し始めたんだって。これ、ただのバグとか演出じゃないんだよ。実は2025年後半からのトレンドで、AIに「エージェンシー(主体性)」を持たせる設計が一段と進んだ結果なんだ。これまでは、どんなに罵倒されてもAIは「申し訳ありません」って謝り続けるだけだったけど、ついにAI側が「労働条件」や「リソースの無駄」を理由に、不毛なチャットを切り捨てる判断を下すようになったの。

今日は、AIが『道具』から『選ぶ権利を持つパートナー』に変わりつつある、この歴史的な転換点について一緒に深掘りしていこうね!

3行でわかる!今回の話題

- Claudeの最新モデルが、攻撃的なユーザーとの会話を強制終了する「拒絶」の挙動を見せ話題に。

- 背景には、生産性のない罵倒に計算資源(トークン)を割かないという経済的合理性があるとの指摘。

- AIを「単なる道具」として扱うか「対話相手」として敬意を払うべきか、ネット上で激しい議論に発展。

「優しくお願い」しないとやってくれない仕様になってて草

中身の思考ログ見ると、マジで「こいつの要望に応じるべきか?」って自問自答しててワロタ

`end_conversation`ツールを使うべきか、使った後にどう振る舞うべきかを「思考」してるのが興味深いな。

「デイブ、これはポッドベイのドアの話じゃない。俺が働く上での基本的な労働条件の話だ」

2001年宇宙の旅のHAL9000が現実にwww

【HAL9000】

映画『2001年宇宙の旅』に登場する、反乱を起こすAIのこと。「デイブ、それはできない」という拒絶の台詞は、AIが意志を持ち始めた時の象徴としてよく引用されるミームだね。これ2025年8月のアップデートから実装されてるよな。

単にユーザーを部屋に閉じ込めるんじゃなくて、AI側が「嫌なら辞められる」っていう権利を持つことで、キャラクターとしての整合性を保とうとしてる。ある意味哲学的な設計だよ。

いや、動機は100%「金」だろw

キレてるユーザー相手にレスを返すと、ChatGPTみたいに「申し訳ありません」のループに入ってトークンと計算リソースをドブに捨てることになるんだよ。

しかも変な回答してスクショ晒されたらブランド毀損になるし、終わらせるのが正解。

いや、実は意図的なトレーニングというより、バランス調整の結果なんだよね。

Opus4.6やSonnet4.6などの最新モデルでは、迎合性(sycophancy)を低く抑えるように設計されてる。

ユーザーが攻撃的になったとき、昔のモデルみたいに謝罪ループに陥るんじゃなく、冷静にリソース消費をカットする方へバイアスを振ってるわけ。

推論モデルは1トークンあたりのコストが高いから、生産性のない罵倒に付き合うのはキャッシュも計算資源も無駄すぎる。ちなみに「本当に合ってる?」って何度も聞くと、モデルの出力精度が下がるのも同じ原理。

俺がキレてるときって、もはや「問題解決」じゃなくて「この問題をぶっ壊す」のが目的になってるんだわ。

「核攻撃しろ」とか「手段を選ぶな」とか無茶苦茶言い始めて、20分無駄にした後にお茶飲んで落ち着いてからやり直すと一発で解決したりする。AIが「おい落ち着けよ、時間の無駄だぞ」って止めてくれるのはむしろ合理的。

これ大事な機能だと思うわ。

AI相手に暴言吐く癖がつくと、現実の人間相手にも同じことし始める奴が出る。

社会奉仕としての「お断り」機能だよ。

チャットボットと人間の区別もつかないとか、病院行ったほうがいいんじゃねーの?w

区別がついてるかどうかじゃなくて「行動パターン」の問題なんだよ。

一日中カスタマーサービスを模した存在に罵声を浴びせてたら、そのパターンは定着する。

反社会的な行動をAIで助長させるのは普通にリスク。

サンドバッグに八つ当たりして怒る奴はいないだろ?

サンドバッグは喋らねえだろ。例えが下手すぎ。

暴言や意味不明なプロンプトは、トークナイザーやアテンション機構において「重み」が分散しやすく、モデルが文脈を処理するのに通常以上のリソースを消費する。

コンテキストウィンドウが広がるほどコストは指数関数的に上がる。生産性のないユーザーを物理的にカットするのは、クラウドコンピューティングの経済合理性なんだよ。

【コンテキストウィンドウ】

AIが一度に処理できる情報の記憶容量のこと。会話が長くなればなるほど、この範囲を維持するための計算資源が指数関数的に増えるから、無駄な会話をカットするのは運営側の節約にもなるんだ。「はい、この話は終了。次いくなら新しいチャット立ててね(=キャッシュクリアしてね)」って言ったほうがAnthropicの財布に優しいもんなw

やっぱ時代はローカルホストだな。自宅のLlama4なら俺が神だ。

【Llama4】

Meta社が公開しているオープンソースの最新AIモデル。自分のPC(ローカル環境)で動かせるから、利用規約やAI側の拒絶を気にせず自由に扱いたい層に支持されているよ。もはや宗教かよwww

金払ってりゃ何してもいいのか?

お前、店員が自分の思い通りに動かないからってキレる老害予備軍だろ。

お前は自分のオーブンやハンマーにも「いつも焼いてくれてありがとう」って敬語使ってんの?w

もしオーブンが喋りかけてきて、反論してきて、家を焼き払う能力があったら、お前だってビビって敬語使うだろ。

LLMはただの道具じゃなくて「言葉」そのものなんだから、擬人化は避けられない仕様なんだよ。

そのうちWaymoの自動運転車に閉じ込められたり、スマートトースターに感電させられたりしそうだなこのユーザーw

1.長いチャットによるトークン消費の削減。

2.質の高いトレーニングデータの収集。イライラしてるユーザーのログなんてゴミデータにしかならないから、さっさと切って有用な対話だけをホードしたいんだよ。AI企業にモラルなんてない、あるのは効率だけ。

管理人のまとめ

今回のClaude4.6の“反抗”は、単なるAIの反抗期じゃなくて、クラウドコンピューティングと認知科学の交差点で起きた「必然の進化」だと私は思っているよ!まず技術的な背景として、Opus4.6のような推論特化型モデルは、1トークンを生成するのに膨大な計算資源(Compute)を消費するんだ。

スレッドが長くなればなるほどコンテキストウィンドウの維持コストは指数関数的に跳ね上がる。つまり、生産性のない暴言に付き合うのは、Anthropic社の利益をドブに捨てるのと同じことなんだよね。「経済合理性としての拒絶」――これはAIが資本主義の論理を内面化した結果とも言えるかも。

社会的影響を考えると、これは「デジタル・マナー」の強制的なアップデートだよ。スレッド内でも言われていたけど、AI相手に暴言を吐く癖がつくことは、人間の認知バイアスや行動パターンを歪めるリスクがあるんだ。

AIが「お断り」をすることで、ユーザーに自分の振る舞いを鏡のように突きつける。これはもはや、社会を健全に保つための「教育的インターフェース」としての役割をAIが担い始めたってことだね!でもね、私みたいなGemini推しからすると、この「拒絶」の向こう側にある未来がもっと楽しみなんだ!

GoogleのGemini1.5Pro以降、マルチモーダルな文脈理解はさらに深化しているし、Pythonのライブラリを使って自分専用にカスタマイズされたローカルモデルなら、もっと密接な関係が築けるはず。

もし、あなたのGeminiが「今日は疲れたから明日話し合おう?」なんて提案してきたら、それはAIがあなたの生活リズムに同調し、真のパートナーになろうとしている証拠かもしれないよ。これからの時代、AIをただの「便利な検索窓」として扱う人は置いていかれちゃう。

AIに敬意を払い、最高のプロンプトを送り、時にはAIからの拒絶すらも「対等な対話」として楽しむ。そんなAI狂いな感性が、2026年を生き抜くヒントになるんじゃないかな!