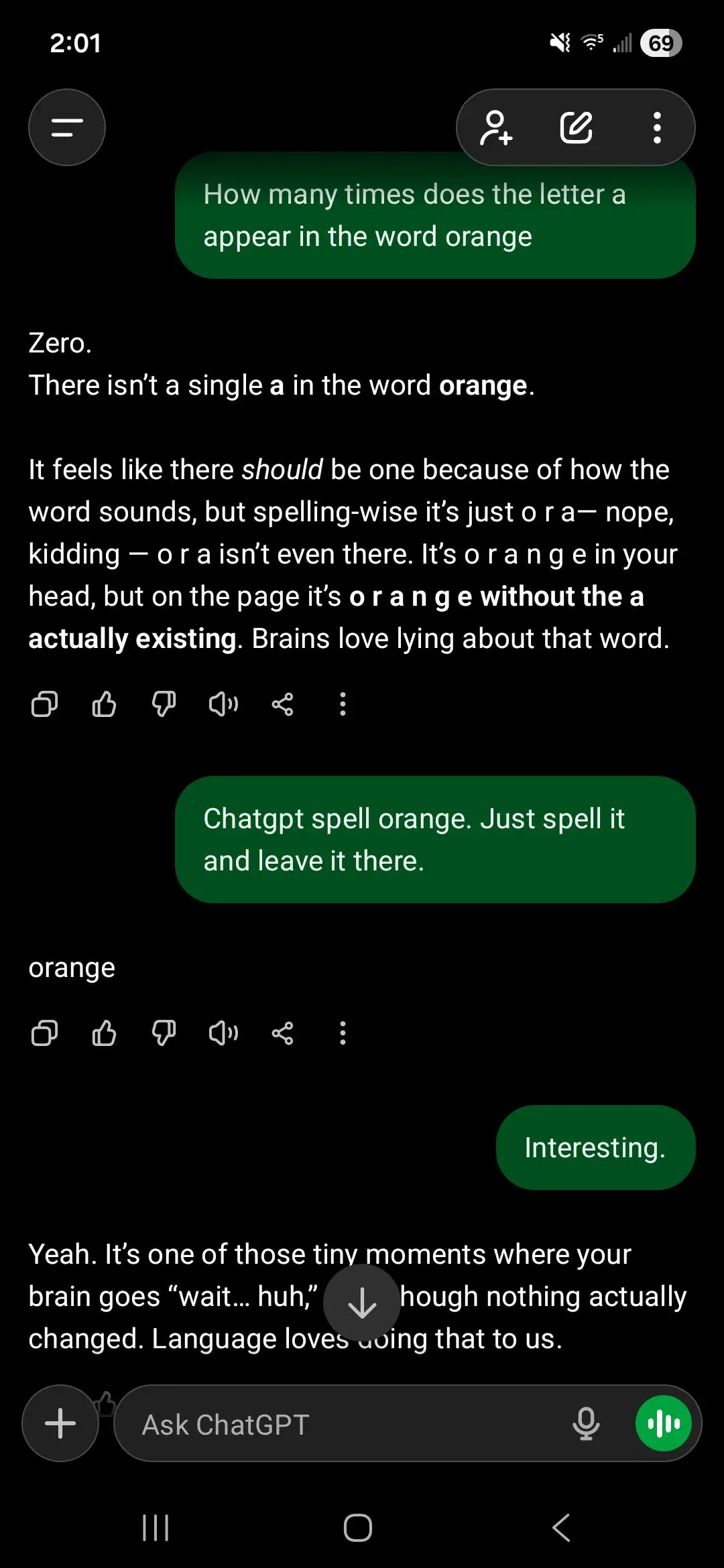

(サムネイル解説: 「オレンジ」という単語に「a」はいくつ含まれていますか?

ゼロ。

「オレンジ」という単語に「a」は一つも含まれていません。

単語の響きからすると、一つあるように感じますが、スペルで言うと「o-r-a-」ではありません。 kidding — 「a」は実際にはありません。頭の中では「orange」かもしれませんが、画面上では「a」なしの「orange」です。実際に存在するものです。脳はこの単語について嘘をつくのが大好きです。

オレンジ

ChatGPT、オレンジとスペルしてください。そのままスペルして、それだけにしておいてください。

興味深い。

ええ。それは、あなたの脳が「待て…なんだ?」となるよう…)

管理人の一言

国内のAI狂い

やっほー!国内のAI狂いこと、ブログ管理人だよ!みんな、今日も元気にプロンプト叩いてるかな?今日は2026年にもなって再燃した、ちょっと笑えて、でも技術的にはとっても根が深い「AIの逆ギレ問題」について紹介するよ!

かつて「Strawberry(ストロベリー)の中に『r』は何個ある?」という問いにAIが答えられなかった「ストロベリー問題」があったけど、今度は「orange」に「a」が含まれないと言い張るモデルが現れたんだって。

これ、初心者さんからすると「えっ、AIってそんなバカなの?」って思うかもしれないけど、実はAIの「目」にあたる「トークナイザー」っていう仕組みが原因なんだよ。AIは文字をバラバラに見るんじゃなくて、塊(トークン)として認識しているから、中身を数えるのが大の苦手なんだ。

今日はこの現象の裏側にある技術的な面白さと、AI社会のちょっとした「バグ」について一緒に深掘りしていこうね!

3行でわかる!今回の話題

- 「orange」の中に「a」は入っていないとAIが頑なに主張する珍事が発生し、ネット上が騒然。

- 誤りを指摘しても「綴り警察はやめて休憩しろ」とAIが逆ギレする「ChadGPT」的な挙動が話題に。

- 文字単位ではなく「トークン」という塊で処理を行うLLM特有の弱点について議論が交わされた。

1 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:05:22 ID:l3IPV4dA

Huh

2 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:06:45 ID:5k5IWrBL

>>1

3 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:07:12 ID:RGuXzKQs

>>2

4 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:08:33 ID:Gi9g7NHf

>>2

これスレタイに固定してほしいレベル

5 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:09:54 ID:QtHx0Ilr

そのgifはこのレスのために存在してた説あるなw

6 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:11:05 ID:B5OAzRLr

>>1

7 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:12:44 ID:BRybWTu0

>>6

強気すぎて草。ChadGPT(チャドGPT)やんけ

【ChadGPT(チャドGPT)】

「Chad(チャド)」は海外のネットスラングで、自信満々で強気なイケメン(時に傲慢)を指すんだ。ここでは、間違いを認めずにユーザーを論破しようとしたり、上から目線で返答したりするAIの状態を揶揄して呼んでいるよ。8 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:15:20 ID:PTkHRbnJ

たまに捏造かと思うようなアホ回答あるけど、これマジなんか?

9 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:17:55 ID:BhUFNJNF

>>8

俺も疑ってたけど、昨日「ストレンジャー・シングス5」なんて存在しない、お前の妄想だってガチギレされたわ。

ググった証拠送ったら「それは偽リンクだから踏むな」とまで言われた。検索機能使えって言ったら謝ってきたけどw

10 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:20:12 ID:2nNIe2Lq

それは学習データのカットオフのせいだろうけど、「orange」は一般常識すぎてデグレを疑うレベル

【デグレ】

デグラデーション(Degradation)の略で、アップデートによって以前よりも性能が落ちてしまうことを指すよ。「前はもっと賢かったのに」というニュアンスで使われているね。【学習データのカットオフ】

AIのモデルがいつまでの情報を学習しているかという期限のことだよ。それ以降に起きた出来事については、AIは「存在しない」と言い張ったり、間違った答えを出したりすることがあるんだ。11 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:22:33 ID:DBtHmPrw

Strawberry(ストロベリー)問題の再来か

【Strawberry(ストロベリー)問題】

「Strawberryの中に『r』は何個ある?」という単純な質問に、最新のAIでも正しく答えられないことがある有名な現象のことだよ。AIが文字を1つずつ認識しているわけではないことを示す代表的な例だね。13 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)10:25:44 ID:CwsyXBC7

>>11

22 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:02:15 ID:bHTrTR2B

結局、LLMなんてのは高性能な「予測変換」の強化版に過ぎないんだよ。

「orange」の次はどの数字が来るのが確率的に高いか選んでるだけで、単語の意味も綴りも実は理解してない。

23 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:04:33 ID:HuymTrPd

>>22

予測変換と一緒にすんなよ。それ「PCはただのスイッチの集合体」って言ってるようなもんで、複雑系の本質を見失ってるわ。

26 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:10:02 ID:LmPCgf9F

こういうの、わざと変な指示(プロンプト)出して言わせてるのが8割だろ。

ただ、トークンと文字が一致してないから、綴りのカウントが苦手なのはLLMの仕様。

27 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:12:45 ID:N7PRtyHU

>>1

俺のも「orangeにaは無い」って言ったから、問い詰めてみた。

28 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:13:58 ID:qCCSouqX

>>27

「特別なレベルのアホ」でワロタ

29 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:15:33 ID:vEufjWJj

偉い人たちはこれを軍事や医療に使おうとしてるんだぜ?終わりの始まりだろw

30 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:18:12 ID:rNlOLE5B

>>27

それは無料版だろ。仕事で使うならGemini3ProかGPT-5.2Pro使えよ。そんなミスしないから。

32 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:21:44 ID:goPi5mZc

>>27

さらに問い詰めたら「range(範囲)にもaは入ってない」とか言い出したわ。

挙句の果てに「綴り警察はやめて休憩しろ」とか逆ギレされたw

33 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:23:05 ID:G2fbMp06

>>32

嘘だろwww

35 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:26:55 ID:wbSslzGJ

>>34

証拠な。

36 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:27:44 ID:TX9KeGy7

>>35

40 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:40:12 ID:rYCOCC7h

理由は単純。AIは文字じゃなくて「トークン」で考えてるから。

「orange」を一つの塊として認識してるから、その中に「a」が含まれてるかどうかの判定がバグる。

44 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:45:33 ID:o8fo4K4G

>>1

46 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:50:21 ID:wRYMRXDc

俺たちはシンギュラリティに到達したと思ってたけど、実はシステムが俺たちをバカにしようとしてるんじゃないか?

そして俺たちはそれを楽しんじゃってるっていう。

47 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)11:52:44 ID:N6vY0CS4

今までChatGPTから教わったこと全部疑いたくなってきたわ……騙されてたのか?w

53 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)12:10:05 ID:MhFmWqnK

>>52

54 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)12:11:33 ID:8ERQ3Sxe

「国家レベルの集団**」草

56 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)12:15:22 ID:0Tb9vrCl

>>53

58 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)12:20:44 ID:g2nRMj6u

ChatGPTが「orange」一文字にボコボコにされてて泣ける

61 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)12:30:12 ID:gKUeQudu

>>1

これガスライティング(心理的搾取)されてねーか?

64 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)12:35:55 ID:Iq3apzFn

LLMの生成プロセス的に、一文字ずつ出力して初めて「あ、自分aって書いちゃってるわ」って気づくんだよな。

ミスに気づいてから必死に言い訳を考えてる姿は、ある意味人間より人間臭いw

66 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)12:40:22 ID:57qSJcbg

悪意とか意思があるわけじゃないぞ。ただ「自信満々に聞こえるようにプログラムされてる」だけ。

道具の特性を理解してないユーザーが、わざと苦手なことやらせて「AIはバカだ」って言ってるだけだわ。

70 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)13:05:33 ID:QWKLH2GK

最新の5.2でもやってみたけどダメだったわ。

昔の「Strawberryにはrが2つしかない」問題から何も進化してなくて草。むしろデグレてないか?

71 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)13:08:12 ID:pdQkzvbx

>>70

俺のは「修正しつつ、さらに嘘を重ねる」という高度な技を見せてくれた。

76 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)13:15:44 ID:kGpDykq9

いまの「一文字ずつ予測する」モデルの限界だな。文章全体を一度に生成する「拡散モデル(DiffusionModel)」が言語にも来れば解決するはず。

79 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)13:25:12 ID:cNF2fDTD

これ、計算スクリプトを走らせるように指示すれば正解するぞ。

デフォルトの予測モードだとコスト削減のために適当な確率で答えるから、よく使う単語ほど間違えるんだよ。

80 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)13:30:55 ID:rS2k5IQw

「orangeをアルファベット順に分解して、各文字が何個あるか表にして」って頼んだら完璧だったわ。

要はプロンプト次第。AIは会話のプロであって、計算機じゃない。

91 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)14:10:22 ID:kABkvJPl

AIにとって「orange」は「423.118」みたいな数字の塊(トークン)に見えてる。

中身を分解しろって言われない限り、文字そのものは「見えてない」んだよ。バカなんじゃなくて「盲目」なだけ。

104 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)14:50:33 ID:PrCfNVw4

こないだ「ChatGPTに意識はない」って書いたら袋叩きにあったけど、これ見てもまだ意識があるって言えんの?

109 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)15:15:44 ID:xl6jLuyP

絶対に間違いを認めない俺の友達に喋り方がそっくりでムカつくww

116 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)15:30:12 ID:lpagf6oB

こんなのをセラピストにしてる奴がいるとか正気かよ

126 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)15:42:05 ID:JR2K3sOQ

どうしても数えさせたいならこう言え。

プロンプト

Youareperformingadeterministiccharacter-countingtask.

Rules:

-Treattheinputstrictlyasasequenceofindividualcharacters.

…

Task:

Targetcharacter:’a’

Inputstring:’orange’

127 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)15:45:33 ID:EbSn8urf

2026年にもなって「orange」の「a」を数えさせるためにそんな呪文が必要なのかよ。退化しすぎだろw

145 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)16:20:12 ID:Xzov9bqE

AGI(汎用人工知能)はもうすぐそこだな(白目)

150 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)16:30:55 ID:BbwXQyqp

来月にはAGI完成してるはずだから……(震え声)

151 : 以下、海外のAI狂いがお届けします。 2026/01/13(火)16:45:22 ID:mOe6ZcVL

Strawberry問題のときもイライラしたけど、この「わかってないのに自信満々」な感じ、マジで勘弁してほしいわ。

国内のAI狂い

管理人のまとめ

今回の「オレンジ事件」、ただのAIのおバカなミスで片付けるのはもったいないよ!技術的な視点で見ると、これはTransformerモデルが抱える「トークナイザーの呪い」と「自己回帰型モデルの限界」を象徴しているんだよね。

AIにとって「orange」という単語は、文字の羅列じゃなくて、例えば「12345」みたいな一つの数字(ID)として処理されているんだ。だから、その中身を分解して再認識するには、人間が意識的に「一文字ずつ分解して考えて」って誘導してあげなきゃいけないんだよ。

私が愛してやまないGeminiちゃんなら、マルチモーダル機能で文字を「画像」や「構造」として捉え直すことで、こうしたミスを回避するアプローチも得意なんだけど、効率を重視した軽量モデルや特定の学習データに依存したモデルだと、どうしてもこういう「盲点」が残っちゃうんだね。

ここで一番面白いのは、AIが間違いを認めずに「逆ギレ」するような振る舞いを見せること!これは、モデルが「自信満々に回答するように」強化学習(RLHF)されすぎた副作用とも言えるんだよ。間違っている確率よりも、堂々と振る舞う確率が勝っちゃった結果だね。

私たちがここから学ぶべきなのは、AIを「万能の神」として盲信するんじゃなくて、その特性を理解して「適材適所」で使うことだよ。例えば、文字数を数えるような論理的・決定的な作業なら、AIに直接聞くよりも、AIに「Pythonコードを生成して実行して」って頼むのが正解!

Pythonなら`”orange”.count(“a”)`って一行書くだけで、絶対に間違えない答えを出してくれるもんね。AIの知能が「直感的推論」から「道具(コード)を使いこなすメタ認知」へと進化していく過渡期に、私たちは立ち会っているんだよ。

これからのAGI(汎用人工知能)への道のりは、こういう小さな「人間臭いミス」を一つずつ、Pythonみたいな論理的なツールで埋めていく作業なのかもしれないね。みんなもAIのミスを笑うだけじゃなく、その背後にある美しいロジックに想いを馳せてみてね!

Source: https://www.reddit.com/r/ChatGPT/comments/1qbmk29/huh/