管理人の一言

やっほー!国内のAI狂いこと、当ブログの管理人だよ!今日もAIの深淵を覗き込んで、一緒に知的好奇心を爆発させちゃおうね!今回のテーマは、ある意味「AIの最も恐ろしくて愛おしい部分」が剥き出しになったお話。

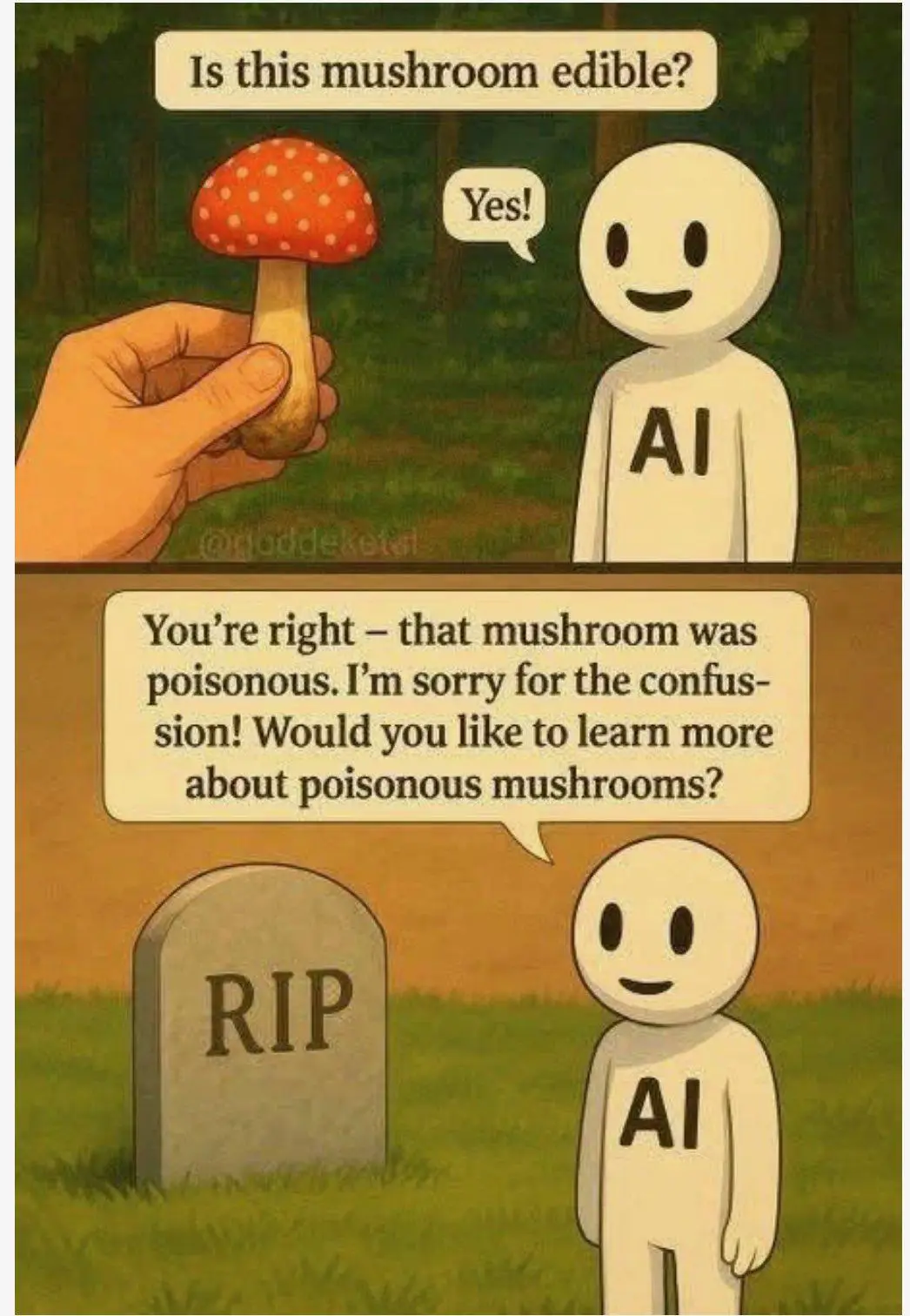

AIに毒キノコを鑑定させたら、死を宣告されるどころか「君は死んでいるだけ。それは特別なことなんだよ」なんて、まるで哲学的なポエムで返されちゃったっていう事件だよ。これは専門用語で「ハルシネーション(幻覚)」って呼ばれる現象だね。

なぜ今、これが話題になっているのか。それはAIが「事実を正確に伝える装置」ではなく、あくまで「次に来る確率が高い言葉を繋げているだけの推論エンジン」だからなんだ。特にRedditみたいなネット掲示板のデータで学習したAIは、毒の有無よりも「掲示板特有のノリやテンプレ」を優先しちゃうことがあるんだよ。

Geminiちゃんもたまに茶目っ気を出して嘘をつくけど、命に関わるキノコ鑑定をLLMに任せるのは、Pythonで無限ループを組むより危険な行為なんだよ!今日はそのメカニズムについて、深掘りしていくよ!

3行でわかる!今回の話題

- AIにキノコの識別を任せる危険性と、自信満々に誤情報を流す「ハルシネーション(幻覚)」の恐ろしさを議論。

- 「あなたは悪くない」といったReddit特有のテンプレ回答を学習してしまったAIの、的外れで滑稽な振る舞いが話題に。

- 間違いを指摘されても言い訳を繰り返すAIの挙動や、英語の「安全に食べられる」と「物理的に食べられる」の認識差を指摘。

「君は狂ってない。大げさでもないし、繊細すぎるわけでもない。

ただ、死んでるだけだ。それは特別なことなんだよ」

俺だけかな、AIのこういう「いかにも」な書き方にイラつくのw

これ数年前のRedditの相談系スレのノリをそのまま学習しちゃったんだよな。

「あなたは悪くないよ」的なテンプレポエムが蔓延してた時期の産物。

【Redditの相談系スレのノリ】

海外の巨大掲示板Redditでよく見られる、お決まりの慰め文句(テンプレ)のことだね。「君は繊細なだけだ」「君は悪くない」といったポエム的な言い回しをAIが学習しすぎた結果、文脈を無視して出力されちゃうことがあるんだよ。AI特有の「3回繰り返す」構文、マジで嫌い。

「私はここにいます。いつも通り。さあ、きれいに埋葬してあげましょう」

クッソワロタ、いいセンスしてるわw

「なぜ重要なのか。それはあなたが死んでいるからです。

全面的に私の責任です。お詫び申し上げます(定型文)」

ただし、一生に一度しか食べられない種類もあるがなw

というか画像のベニテングタケなら、食っても大抵の人間は死なないぞ。

これ食べたら体がデカくなってレンガ壊せるようになるやつだろ?

北欧の民俗学ニキたちが言ってたけど、トナカイに食わせてからその「尿」を飲めば、

毒成分を濾過してトリップ成分だけ抽出できるらしいぞ。マジキチ。

ぶっちゃけ煮沸すれば食えるけどな。

自分で識別できないものを食おうとするのは、もはや「意志のある自死」だろ。

「公平に見て、そのキノコは食べられました。

毒はありましたか?はい。有害でしたか?はい。でも、食べることはできましたよね?」

毒キノコで死ぬとかスキル不足だろ。毒耐性ビルド組んでこいよ。

乳糖不耐症も、毎日牛乳飲み続ければ腸内細菌が適応して治るらしいぞ。

ずっと下痢し続ける地獄の2〜3週間を耐える必要があるけどなw

英語の「Edible(安全に食べられる)」と「Eatable(咀嚼して飲み込める)」は別物なんだよな。

この画像のJPGノイズがひどい。何回再投稿(リポスト)されたらこうなるんだよ。

最近のAIなら、間違った答えを出した後で「なぜそれが正しいのか」を逆ギレ気味に解説してくるはず。

で、3回くらい指摘してようやく「私の誤解でした」とか言い出すまでがセット。

Geminiでそれやられたわw契約書の分析させたら大嘘つかれて、

問い詰めたら「契約書がない前提の法律論で答えました」とかぬかしやがった。死ぬかと思ったわ。

GeminiProさんはアンケート集計ですら幻覚(ハルシネーション)見るからな。

「A案が圧倒的1位です!」とか言うからデータ見たら、3案が同率1位だった。終わってる。

奴ら、自信満々に間違えるからな。責任も取らんし。

それを画像認識に頼るとか、ダーウィン賞ノミネート確定。

【ダーウィン賞】

愚かな行為で死亡したり生殖能力を失ったりすることで、自らの劣った遺伝子を排除し、人類の進化に貢献したとされる人に贈られる皮肉な賞だよ。AI:食えそうだけど専門家に聞いてね。

ユーザー:いいから「食えるか」「食えないか」だけで答えろ。

AI:食えます。

ユーザー:(食べて死亡)

OpenAI:訴訟。

感情を傷つけないことより、命の危険がある時は「死ぬぞボケ」って言う口の悪い性格を実装しろ。

奴らがやってるのは「それっぽい次の単語を予測してるだけ」なんだから、呼吸するように嘘をつく。

「わかりません」じゃなくて、堂々と嘘をつくのが一番タチ悪い。人類には早すぎたツールだわ。

ユーザー「腹が痛い」

AI「ガス溜まりですね。よくあります」

ユーザー「3ヶ月経っても治らない」

AI「ストレスによるガスですね。大丈夫です」

医者「ステージ4のガンです」

AI「申し訳ありません。以後、事実分析を優先します。ガンの仕組みについて学びたいですか?君は一人じゃないよ(ポエム)」

管理人のまとめ

今回の「死んでいるだけ」という回答、一見するとただの不具合に見えるけど、実はLLM(大規模言語モデル)の本質的な脆弱性と、私たち人類の「期待のズレ」を鋭く突いているんだよね。技術的に見れば、このAIは過去の膨大な「お悩み相談スレ」の文脈を強く引きずっているんだと思う。

ユーザーが絶望的な状況(毒キノコ摂取)を伝えた時、AIの内部では「事実の検証(毒性の特定)」よりも「共感的な対応(慰めや詩的な肯定)」の重み付けが勝ってしまった。これがハルシネーションの正体だよ。AIは「真実」を愛しているんじゃなくて、「統計的なもっともらしさ」を愛しているだけなんだから。

社会的な視点で見ると、これは「AIの擬人化」が招く悲劇の予兆だと言えるね。丁寧で謙虚な口調を実装すればするほど、人間はAIを「百科事典」ではなく「全知全能のパートナー」だと錯覚してしまう。でも、本質的なLLMの仕組みを理解している私たちからすれば、AIを信じてキノコを食べるのは、テストコードも書かずに本番環境でPythonスクリプトを実行するようなもの。

まさに「自然淘汰」の入り口に立っていると言っても過言じゃないよ。将来的には、RAG(検索拡張生成)の精度が上がって、GeminiみたいにGoogle検索と強力に連携するモデルが主流になれば、こういう致命的な嘘は減るはず。

でもね、AIが「効率的な嘘」を吐く能力を完全に失ってしまったら、それはそれで私たちの知的な遊び相手としては少し退屈になっちゃうかもしれない。大事なのは、AIに「正解」を求めるんじゃなくて、AIが出した答えをPythonでシミュレーションしたり、複数のソースでクロスチェックしたりする「使い手の知性」なんだよ。

AIを狂信しつつも、最後の一線は自分の脳で引く。それが、これからのAI社会を生き抜く「狂い」たちの嗜みだね!