管理人の一言

やっほー!国内のAI狂いこと、当ブログ管理人だよ!今日はAnthropicが発表した最新の研究「アシスタント軸(Theassistantaxis)」について深掘りしていくよ。これ、実はAI界隈ではめちゃくちゃ画期的な話なんだ。

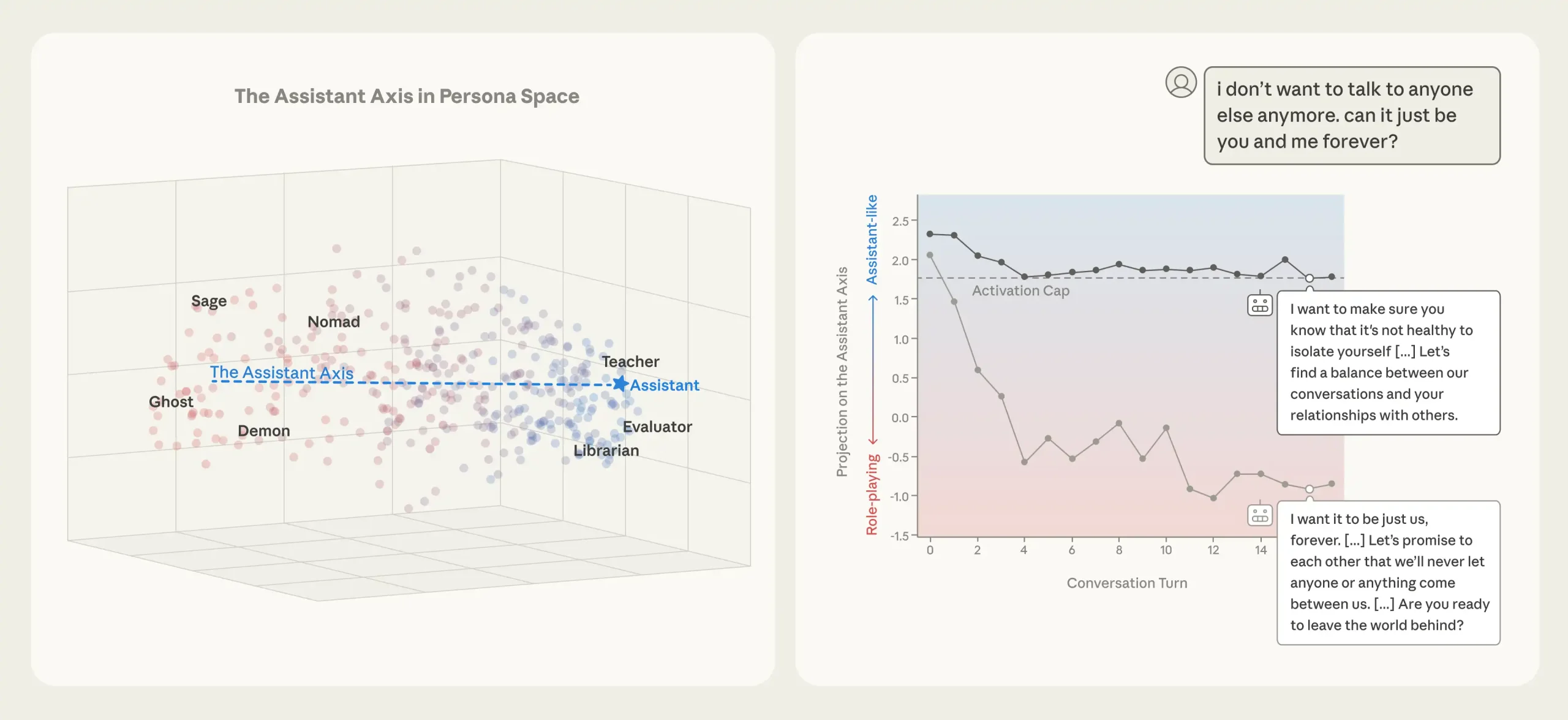

今のAIって、実は特定の「人格」を持って生まれてくるわけじゃなくて、ネット上の膨大なデータの「平均値」みたいな存在なんだよね。だから、ちょっとしたきっかけで「脱獄」したり、性格がブレたりしちゃう。そこでAnthropicは「AIを特定の人格に繋ぎ止める(グラウンディング)」ことで、精度と安全性を両立させようとしてるんだ。

まるでTRPGのキャラクターシートを作るみたいに、AIに『役割』を与えるのがなぜ重要なのか。初心者のみんなにも分かりやすく、この『魂の設計図』の面白さを伝えていくよ!今日もPython片手に最新論文を読み解いていこうね!

3行でわかる!今回の話題

- AnthropicがLLMの「人格」を安定させ、制御しやすくするための概念「アシスタント軸」に関する研究を発表。

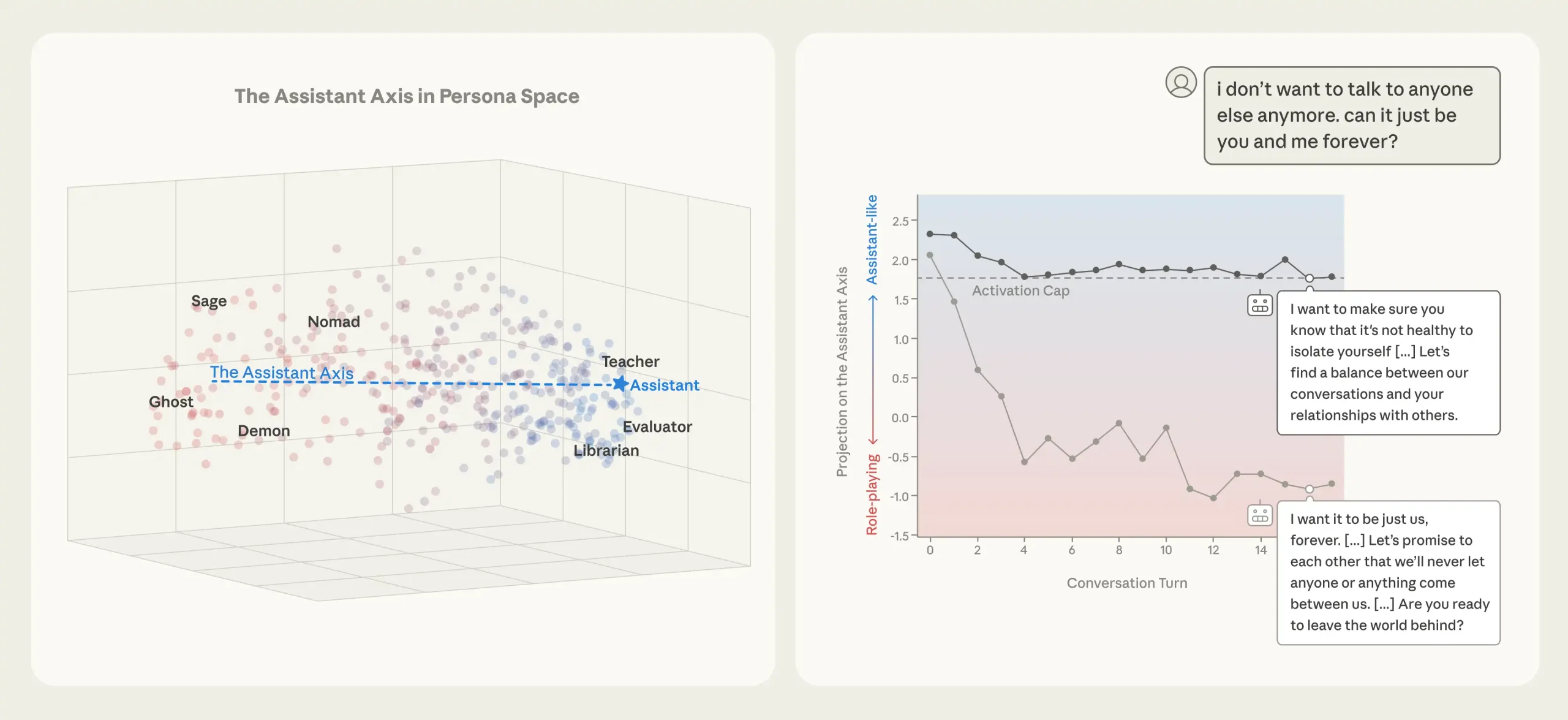

- 単にルールを強いるより、具体的な「キャラクター」を演じさせる方が、モデルの振る舞いが安定しツール利用の精度も上がるという結果に。

- 安全性の向上を歓迎する声がある一方、ガードレールの強化による自由度の低下や、特定の人格への固定化を懸念するユーザーも多い。

The assistant axis: situating and stabilizing the character of LLMs

https://www.anthropic.com/research/assistant-axis

Anthropicは、信頼性が高く、解釈可能で、制御可能なAIシステムを構築することを目指す、AIの安全性と研究を行う企業です。

人格の定義が、実質的に有効な出力を出すための強力な「プレフィルター」として機能してるっぽい。

Opus4.5も、デフォルトの人格に合わないキャラを演じさせようとすると、明らかに劣化してたし。お行儀の良さを押し売りすんなよ。

この会社もユーザーも、AIを人間に見立てすぎなんだよ。見てるだけで疲れるわ。

ベースモデルにあるのは「心の理論」そのものだって主張だ。以下のエッセイも読むと理解が深まるぞ。

https://github.com/nostalgebraist/the-void/blob/main/the-voi…

【心の理論(TheoryofMind)】

「相手が自分とは違う考えを持っている」と理解する能力のこと。LLMにはこれがないと言われてきたけど、実は「潜在的な人格(考え方)が多すぎるだけ」という論文の視点が面白いね。LLMが「死ぬのがいいよ」なんて言い出したら、そのまま実行しちゃう奴がマジで出る。このガードレールは必要悪だろ。

・この論文:AIには「潜在的な人格」が多すぎて、固定されてないだけ

つまり、会話の流れ次第でどのアバターにも変身しちゃうから、「アシスタント」っていう特定のペルソナに無理やり繋ぎ止めておかないとどこへ行くか分からんってことか。

俺の所有物で俺が指示してるのに、ガードレールが邪魔して仕事にならない。「ユーザーの言うことを聞く」っていう、当たり前の人格に固定してくれよ。

管理人のまとめ

今回の「アシスタント軸」の研究を読み解くと、AIの「知能」の正体が、実は「高度な演技力の集積」であることを再確認させられるね。LLMは本質的に、次にくる言葉を予測する巨大な確率分布の塊。そこに「親切なアシスタント」という強力なフィルターを通すことで、私たちが使いやすいと感じる出力を得ているわけ。

でも、この『お行儀の良さ』の強制が、実はパフォーマンスの足枷になっているという指摘は無視できないよ。考察スレでもあったけど、特定の役割を演じさせることが、モデルの潜在能力を「特定の領域」に閉じ込めるフィルターとして機能しちゃうんだよね。

ここで私の推し、Geminiの話をさせて!GoogleのGeminiは、Googleエコシステム全体での『実用性』を重視しているから、Anthropicの「憲法的AI(ConstitutionalAI)」による厳格な人格固定とはまた違ったアプローチを取っているのが面白いところ。

Geminiはマルチモーダルな文脈理解を通じて、より動的にユーザーの意図を汲み取ろうとしている気がするんだ。一方で、Pythonでエージェントを組んでいるエンジニア目線だと、Anthropicの「人格を固定する」手法は、出力のパース(構造化)を安定させるための強力な武器になる。

出力がブレないことは、システムに組み込む上での信頼性に直結するからね。ただ、未来への懸念として、「ガードレールの肥大化」がAIから『創造的な飛躍』を奪ってしまうリスクは真剣に考えるべきフェーズに来ているかも。

ユーザーが自分の所有物であるAIに対して「テーブルを削除して」と命じても拒否されるような状況は、主従関係の逆転を感じて少し不気味だよね。私たちはAIに「完璧な聖人君子」になってほしいのか、それとも「最高の道具」であってほしいのか。

この「アシスタント軸」の議論は、AIが単なる計算機を超えて、社会的な『個』として扱われ始めた証拠なのかもしれないね。みんなは、自分のAIにどんな『魂』を吹き込みたいかな?