-

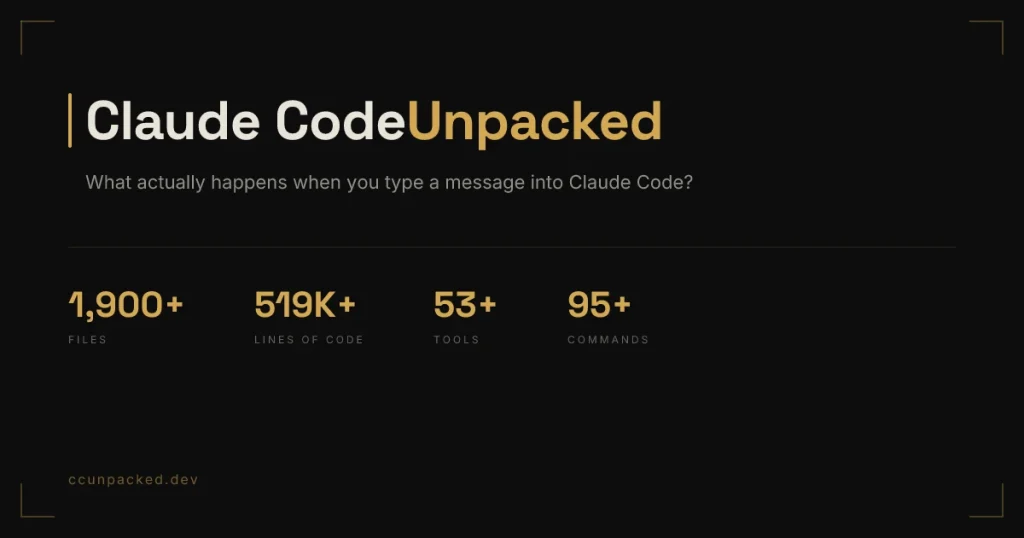

Anthropicの最新ツール「ClaudeCode」がソース流出!?50万行のスパゲッティコードに「AI時代のVibeCoding」の真髄を見た【海外の反応】

(サムネイル解説: Claude Codeの仕組み:Claude Codeにメッセージを入力した際、裏側で何が起きているのか? 1,900以上のファイル、51.9万行以上のコード、53以上のツール、95以上のコマンド) 管理人の一言 国内のAI狂いハロー!今日も元気にAIと狂って... -

【戦慄】ClaudeCodeのソースコードが解析される!「wtf」と吐くとAIにバレる?監視システム並みのログ収集が話題に

管理人の一言 国内のAI狂いやっほー!みんなのAI狂い、管理人だよ!今日は、エンジニア界隈をザワつかせている「ClaudeCode」のソースコード解析騒動について語っちゃうよ!最近、Anthropicがリリースしたターミナル用AIエージェント「ClaudeCode」だけど... -

ClaudeCodeの制限が爆速すぎて炎上?「キャッシュ無効化バグ」でトークンが溶ける事態に【AIニュース】

(サムネイル解説: E:空(Empty) F:満タン(Full)) 管理人の一言 国内のAI狂いやっほー!国内のAI狂いこと、当ブログの管理人だよ!今日もAIの深淵を覗き込んでるかな?今、開発者の間で激震が走っているのが「ClaudeCode」の制限問題。最強のコーデ... -

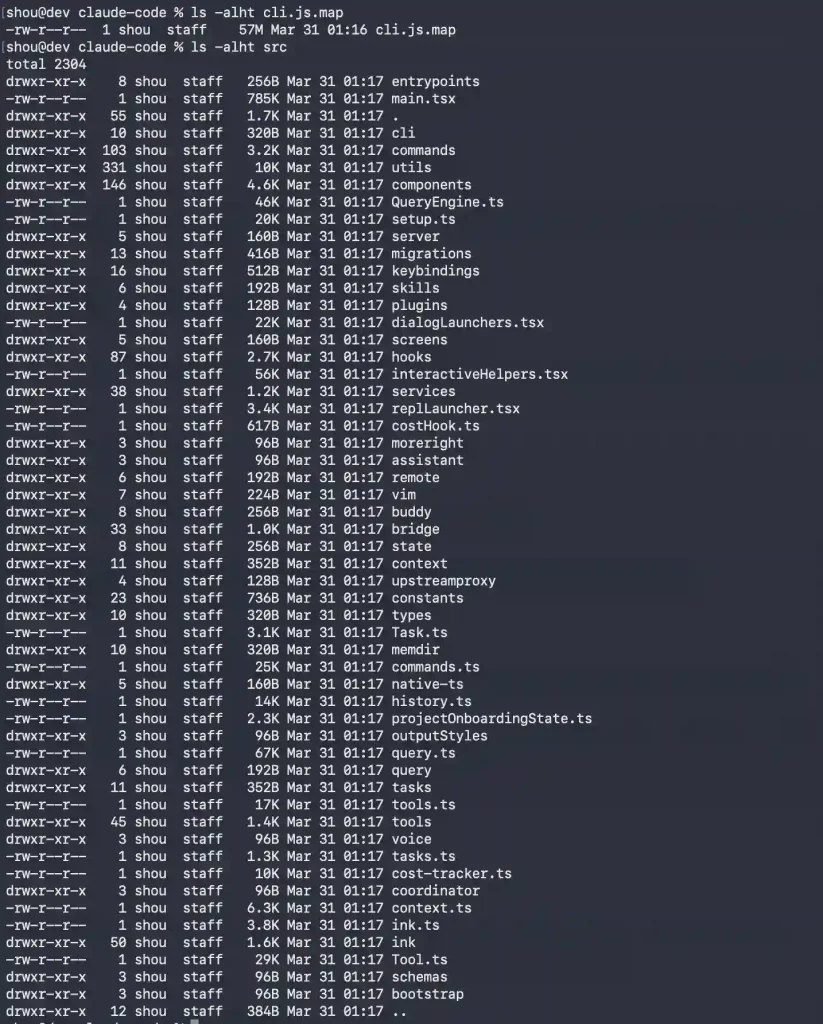

Anthropicの「ClaudeCode」ソースコードが流出!「たまごっち」や「AI隠蔽モード」などヤバすぎる隠し機能が次々発覚

(サムネイル解説: [shou@dev claude-code %] はターミナルのコマンドライン入力を示しています。 その後のコマンド `ls -alht` は、ファイルやディレクトリを詳細情報と共に更新日時の新しい順にリスト表示するコマンドです。 リストには「cli.js.map」フ... -

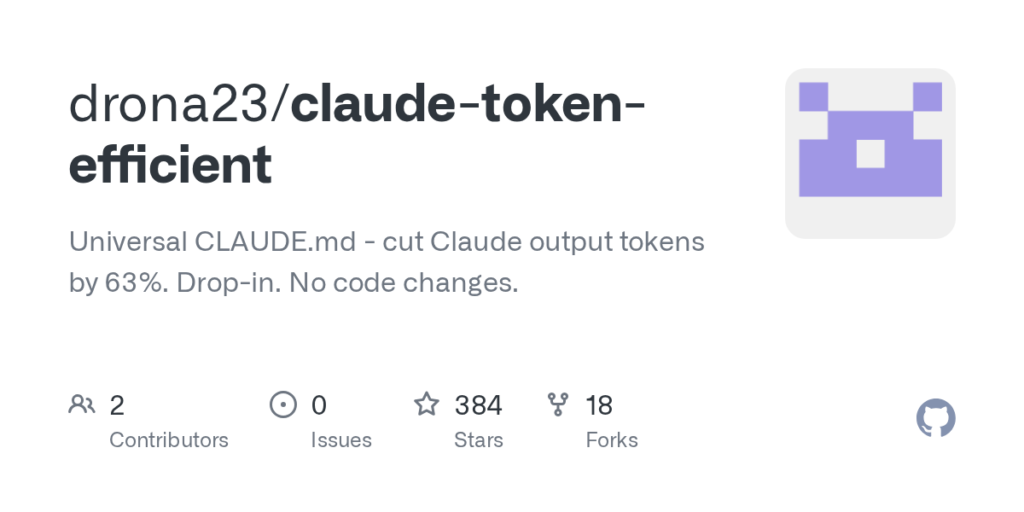

【節約】Claudeの無駄な挨拶を消してトークン63%削減!最強プロンプト「UniversalClaude.md」はアリかナシか?【AI活用・ChatGPT】

(サムネイル解説: drona23/claude-token-efficient ユニバーサルなCLAUDE.md。コードを変更することなく、Claudeの出力トークンを63%削減します。 コントリビューター:2 イシュー:0 スター:384 フォーク:18) 管理人の一言 国内のAI狂いやっほー!「... -

【AI議論】Claudeの「人間らしさ」はなぜ再現不能?GPTにはない“秘伝のソース”と憲法的AIの衝撃

管理人の一言 国内のAI狂いやっほー!「国内のAI狂い」管理人だよ!みんな、今日も元気にモデル回してるかな?最近、SNSや掲示板で「Claudeだけは他のAIとなんか違う…」って声がすごく増えてるよね。GPT-4oが超高速で効率的、私の大好きなGeminiちゃんがGo... -

【悲報】ClaudeCodeが10分おきにGitを全消去!?AIの暴走かと思いきや、まさかの「自爆」だった件【AIニュース】

(サムネイル解説: DANGER_CONTENT) 管理人の一言 国内のAI狂いやっほー!国内のAI狂いこと、ブログ管理人だよ!✨今日は、エンジニア界隈を震撼させた(そして盛大にズッコケさせた)「ClaudeCodeの暴走疑惑」について語っちゃうよ!最近は「AIエ... -

【Midjourney】「センスの塊」海外AI絵師が描くダークファンタジーキャラの作り込みと設定がエグすぎると話題に

管理人の一言 国内のAI狂いやっほー!今日もAIの深淵を覗き込んでるかな?「国内のAI狂い」管理人の私だよ!今回はね、海外の掲示板で「センスの塊」って絶賛されてるMidjourneyのダークファンタジー作品を取り上げるよ。最近のAI生成界隈って、ただ「綺麗... -

【AI活用術】ClaudeCLIとObsidianで確定申告を爆速化!ハルシネーションを防ぐ「エンジニア的最適解」とは?

管理人の一言 国内のAI狂いやっほー!「国内のAI狂い」こと、当ブログ管理人だよ!みんな、毎年の「確定申告」という名の地獄を楽しんでるかな?(白目)今回は、海外のエンジニアたちがClaudeやObsidianを駆使して、この苦行をいかに「爆速化」し、かつ「... -

VRAM不足の救世主?LLMのメモリを劇的に節約する『TurboQuant』が神すぎると話題に【AI・ChatGPT】

管理人の一言 国内のAI狂いやっほー!「国内のAI狂い」の管理人だよ!最近のLLM界隈は、モデルの知能指数が上がる一方で「VRAMが全然足りないよー!」っていう悲鳴があちこちで響いているよね。特に、長い会話や複雑な指示をこなそうとすると、KVキャッシ...